La torre Eifel está en llamas. Millones de vistas, reproducciones, veces compartidas y respuestas.

Una de estas fotografías se compartió el 15 de enero de 2024, por @itorcat en X,

quien cuenta con menos de 20 seguidores. El mensaje que la acompañaba decía:

Este último perfil, cuya publicación tuvo más de 281, 000 reproducciones y más de 500 “me gusta”, casi dos horas después publicó una aclaración:

En el corazón de cualquier democracia saludable se encuentra la premisa de que los ciudadanos deben tomar decisiones informadas, especialmente, durante los procesos electorales. La información veraz y precisa no sólo empodera al electorado para que elija representantes y políticas que reflejen sus valores y necesidades, sino que también lo ayuda a configurar su cosmovisión del mundo y a reforzar su confianza en las instituciones democráticas. Sin embargo, este ideal se ve cada vez más amenazado por la proliferación de la desinformación, un fenómeno que ha encontrado en la Inteligencia Artificial (IA) un poderoso vehículo para amplificar su alcance e impacto.

La desinformación, definida como la creación y difusión intencional de información falsa o engañosa, ha sido utilizada a lo largo de la historia como herramienta para influir en la opinión pública y manipular los resultados electorales. No obstante, el surgimiento de tecnologías avanzadas de IA ha transformado el escenario, permitiendo la generación de contenido falso con un realismo y una escala sin precedentes.

En el contexto de las elecciones en Latinoamérica y Estados Unidos, la desinformación impulsada por IA no sólo socava la calidad del debate público, sino que también amenaza la integridad de los procesos electorales. En estas regiones, caracterizadas por su baja actividad política y sus desafíos en términos de polarización y desconfianza institucional, actores malintencionados, desde gobiernos hasta grupos particulares con intereses específicos, pueden emplear estas tecnologías para influir en la percepción pública, desacreditar a oponentes políticos o incluso fomentar conflictos sociales.

El problema de la desinformación impulsada por IA en las elecciones en Latinoamérica y EE. UU. exige respuestas multifacéticas que involucren a gobiernos, empresas tecnológicas, sociedad civil y el propio electorado. Identificar, entender y contrarrestar este fenómeno es crucial para preservar la integridad de los procesos democráticos y asegurar que las decisiones electorales reflejen la voluntad genuina del pueblo.

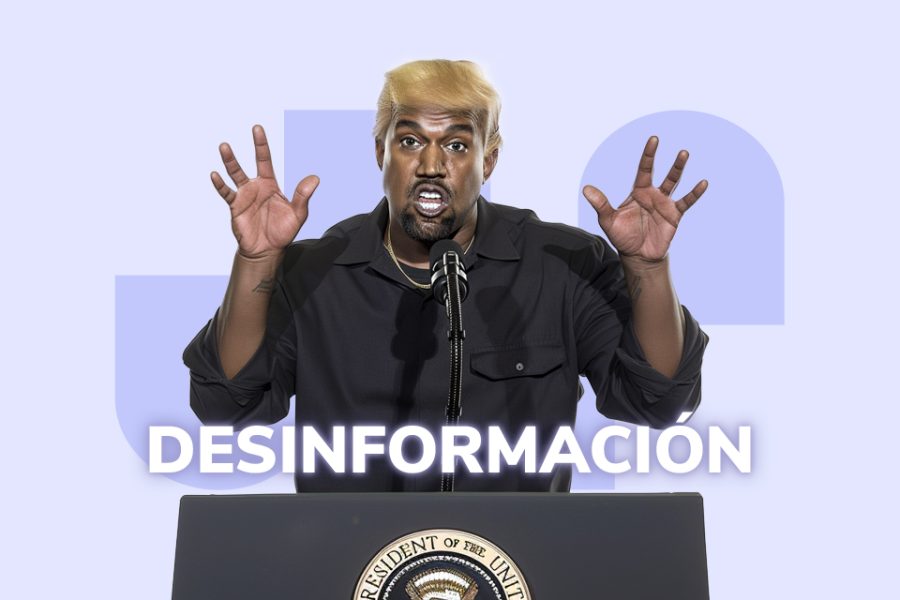

Pie de foto: La imagen muestra al expresidente, Donald Trump,

presuntamente arrestado por las autoridades, pero es falsa.

Antes de la era digital, la desinformación requería un esfuerzo considerable para su producción y distribución, lo que limitaba su alcance. Un ejemplo histórico puede ser la campaña de desinformación durante la Guerra Fría, donde tanto Estados Unidos como la Unión Soviética utilizaron propaganda para influir en la percepción pública global y en elecciones específicas en países de interés estratégico. Aunque efectivas, estas campañas estaban restringidas por los medios de comunicación de la época y por la capacidad de los gobiernos y organizaciones para controlar la narrativa.

Para comprender el impacto de la IA en Latinoamérica, basta mencionar las elecciones en países como Brasil y México, las cuales han evidenciado el uso de WhatsApp y otras redes sociales para esparcir rumores y noticias falsas, afectando la percepción de los candidatos y de las propuestas políticas. Políticos como Milei han utilizado eficientemente las redes sociales para establecerse con sus posibles votantes.

Estos avances tecnológicos han permitido no sólo crear contenido falso con una verosimilitud asombrosa, sino también segmentar y personalizar los mensajes de desinformación para dirigirlos a grupos específicos, explotando vulnerabilidades sociales y políticas con una exactitud sin precedentes. Este nivel de sofisticación dificulta enormemente la tarea de verificar la información y combatir la desinformación, así como evitar que se viralice.

La evolución de la desinformación con la tecnología de IA representa, por lo tanto, un desafío sin precedentes para la integridad de los procesos electorales. La capacidad de generar y difundir información falsa a gran escala amenaza tanto el resultado de elecciones específicas como la confianza en las instituciones democráticas y en los medios de comunicación, pilares fundamentales de cualquier sociedad democrática. Reconocer y adaptarse a esta nueva realidad es crucial para salvaguardar la democracia en la era digital.

La IA ha aportado herramientas sofisticadas para influir en la percepción pública y alterar el discurso democrático de manera diferente. Estas son algunas de las más relevantes:

La calidad de videos, audios o imágenes falsas ha superado por mucho las regulaciones y legislaciones, lo que significa que la batalla contra la desinformación ya no sólo se libra en el dominio de la verificación de hechos, sino también en el desarrollo de tecnologías capaces de detectar y neutralizar el contenido falso generado por IA. La lucha contra la desinformación en la era digital exige una respuesta coordinada que involucre tecnología avanzada, educación mediática y políticas públicas robustas.

La capacidad de la desinformación para moldear opiniones, sembrar división y manipular el comportamiento electoral plantea serias preocupaciones para la salud de las democracias modernas.

Impacto en la percepción pública

La desinformación diseñada para engañar y manipular la opinión pública puede alterar significativamente la percepción de los ciudadanos sobre los candidatos políticos, las políticas propuestas y los temas de actualidad. Al presentar información falsa como si fuera verdadera, socava la capacidad de los electores para tomar decisiones informadas y puede confundirlos, erosionando la confianza en los medios de comunicación legítimos y en las fuentes de información autorizadas.

Impacto en la integridad electoral

La integridad de los procesos electorales se ve amenazada cuando la desinformación interfiere en el debate público. Esto puede incluir desde la difusión de rumores sobre la fiabilidad del sistema de votación hasta campañas de desprestigio basadas en hechos falsos contra candidatos específicos. Estas tácticas, en el mediano o largo plazo, pueden llevar a los ciudadanos a cuestionar la legitimidad del gobierno electo.

El impacto de la desinformación en la sociedad y en los procesos electorales resalta la necesidad urgente de abordar este fenómeno. Combatir la desinformación requiere un enfoque multidisciplinario que incluya la educación mediática, el fortalecimiento de las políticas de verificación de hechos y la colaboración entre plataformas tecnológicas, gobiernos y organizaciones civiles.

La lucha contra la desinformación, especialmente aquella impulsada por la IA, exige un conjunto de estrategias y herramientas sofisticadas, así como la colaboración entre diferentes sectores de la sociedad. Estas son algunas de las más importantes.

Herramientas y técnicas para contrarrestar la desinformación

Iniciativas gubernamentales, de ONGs y sector tecnológico

A pesar de estos esfuerzos, la detección y mitigación de la desinformación sigue siendo un desafío debido a la constante evolución de las tecnologías de IA y las tácticas empleadas por los actores de la desinformación. La efectividad de estas estrategias depende de la adaptación continua a las nuevas tendencias de desinformación, así como de la colaboración entre sectores para desarrollar respuestas más robustas y efectivas.

Como sociedad, debemos combatir la desinformación con la promoción de información veraz. Sin duda, la democracia se basa en la premisa de un electorado bien informado, capaz de tomar decisiones basadas en hechos y análisis objetivos.

Además, para que la batalla contra la desinformación sea continua y eficiente, requiere un compromiso constante con la verdad, la transparencia y la educación. Sólo mediante la colaboración y la innovación podremos asegurar que la democracia permanezca resiliente frente a los intentos de socavarla. La integridad electoral y la veracidad de la información no son sólo cuestiones políticas, sino también pilares fundamentales sobre los que se construye una sociedad justa, equitativa y libre.

Allcott, H., & Gentzkow, M. (2017). Social Media and Fake News in the 2016 Election. Journal of Economic Perspectives, 31(2), 211-236. https://doi.org/10.1257/jep.31.2.211

Bovet, A., & Makse, H. A. (2019). Influence of fake news in Twitter during the 2016 US presidential election. Nature Communications, 10(1), 7. https://doi.org/10.1038/s41467-018-07761-2

Lazer, D. M. J., Baum, M. A., Benkler, Y., Berinsky, A. J., Greenhill, K. M., Menczer, F., … Zittrain, J. L. (2018). The science of fake news. Science, 359(6380), 1094-1096. https://doi.org/10.1126/science.aao2998

Shao, C., Ciampaglia, G. L., Varol, O., Flammini, A., & Menczer, F. (2018). The spread of low-credibility content by social bots. Nature Communications, 9(1), 4787. https://doi.org/10.1038/s41467-018-06930-7

Woolley, S. C., & Howard, P. N. (Eds.). (2019). Computational Propaganda: Political Parties, Politicians, and Political Manipulation on Social Media. Oxford University Press. https://doi.org/10.1093/oso/9780190931407.001.000

Ferrara, E., Varol, O., Davis, C., Menczer, F., & Flammini, A. (2016). The Rise of Social Bots. Communications of the ACM, 59(7), 96-104. https://doi.org/10.1145/2818717

Ruy Renau

Redactor en EXPOSTComunicólogo, unfluencer, dog dad, emprendedor de 5 cifras, traumado con la IA y el dominio de las máquinas. Melómano, cinéfilo, lector, gamer, arte, contra cultura y re-curioso. Ultra puntual en todo siempre y cero despistado. Valores cristianos.

Todos los derechos reservados IEXE 2022 Aviso de Privacidad Contacto

Agradezco la información tan valiosa que nos proporcionas, obtuve el conocimiento de nuevos términos empleados a la par que la IA adquiere mayor relevancia, asimismo, crear conciencia en la obtención de información a fondo y no generar controversia o dudas acerca de un tema por la simple lectura en una red social.