En los últimos años, el uso de herramientas como ChatGPT se ha vuelto común en escuelas y universidades mexicanas. Para muchas personas, esto se ha interpretado como una señal de avance en la alfabetización digital en México. Sin embargo, usar inteligencia artificial todos los días no significa, necesariamente, que estemos desarrollando habilidades para pensar mejor, entender la información o tomar decisiones de forma crítica.

Este texto parte de una idea sencilla: tener acceso a la inteligencia artificial no equivale a comprender cómo funciona la información ni a pensar de manera autónoma. De hecho, cuando la IA se usa sin cuestionarla, puede debilitar el aprendizaje en lugar de fortalecerlo.

Hoy es común ver trabajos bien escritos, ordenados y “correctos”, pero cuando se le pregunta al estudiante cómo llegó a esas respuestas, no sabe explicarlo. No es falta de esfuerzo: es que el proceso de investigar, contrastar y comprender fue reemplazado por una sola acción: preguntar algo a ChatGPT y copiar la respuesta.

Frases como “si ChatGPT lo dice, debe estar bien” se escuchan cada vez más. La herramienta dejó de ser un apoyo para pensar y se convirtió en la fuente principal, y a veces única, de información. Ya no se usa nada más para aprender, también para resolver rápido.

El problema no es usar inteligencia artificial en la educación; el problema empieza cuando se deja de cuestionar lo que dice.

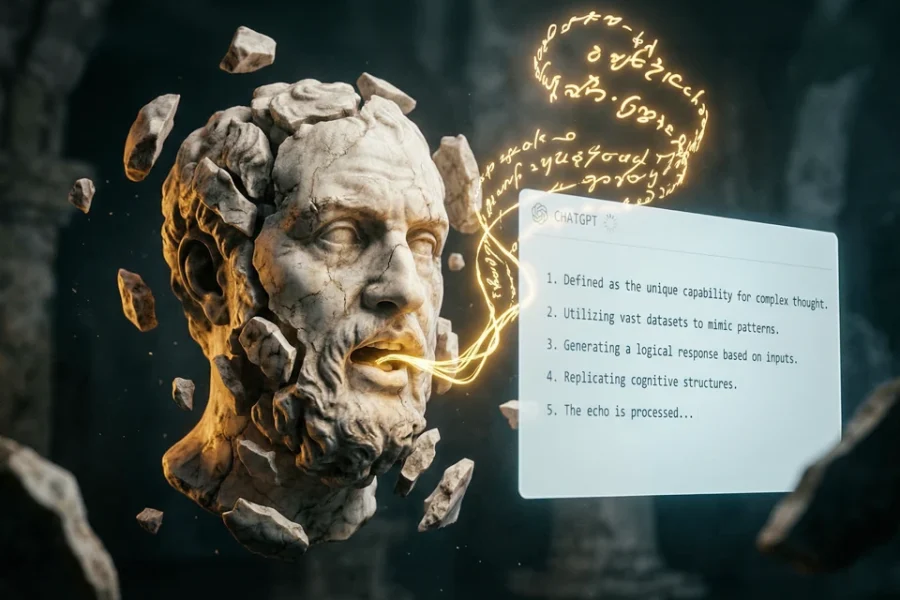

ChatGPT no piensa, no investiga y no verifica hechos. Genera texto a partir de patrones del lenguaje. Puede equivocarse, simplificar temas complejos, repetir sesgos o incluso inventar datos que suenan creíbles.

Cuando una persona no tiene herramientas para detectar estos errores, la respuesta automática se asume como verdad. Así, el juicio propio se reemplaza por la respuesta más rápida. En lugar de fortalecer el aprendizaje, se crea dependencia.

Usar ChatGPT como apoyo puede ser útil, pero usarlo como autoridad final empobrece el pensamiento.

Uno de los riesgos más importantes de los sistemas de inteligencia artificial es lo que se conoce como alucinaciones. Esto ocurre cuando la herramienta ofrece información falsa o imprecisa con total seguridad, aunque no sea correcta.

El problema es que estas respuestas suelen estar bien redactadas y sonar convincentes. Sin pensamiento crítico, es difícil distinguir entre información válida y errores. Por eso, confiar ciegamente en la IA puede llevar a aprender cosas incorrectas sin darse cuenta.

La alfabetización digital no es únicamente saber usar aplicaciones, plataformas o herramientas nuevas; es saber evaluar información, entender de dónde viene y reconocer sus límites.

De acuerdo con el libro de IEXE Editorial: Democratización de la tecnología. El camino hacia la inclusión digital en México, de Martín Yeshúa Barragán, el desarrollo personal y profesional depende en parte de la alfabetización digital y, para que esta tenga lugar, es necesario diseñar programas adaptados a personas de diferentes grupos de edad y contextos sociales.

En el escenario mexicano, esto es especialmente importante. Las desigualdades educativas y el acceso desigual a información de calidad hacen que muchas personas dependan casi por completo de herramientas digitales para aprender e informarse. No obstante, sin habilidades críticas, es decir, sin programas que las proporcionen o desarrollen, esa dependencia se vuelve un problema.

Estos programas no deben limitarse a garantizar el acceso a internet. Martín Yeshúa Barragán, en su libro sobre democratización de la tecnología, considera que dichas intervenciones deben abarcar cuatro dimensiones.

Es dentro de la dimensión educación que se encuentra la alfabetización digital, es decir, la que puede promover el uso de herramientas como ChatGPT de manera informada, juiciosa y responsable.

Aprender a pensar críticamente significa saber:

Cuando todo se reduce a copiar una respuesta automática, estas habilidades se debilitan. La educación pierde profundidad y el aprendizaje se vuelve superficial. La inteligencia artificial puede apoyar el aprendizaje, pero no puede reemplazar el proceso de pensar.

Otro punto clave es la alfabetización algorítmica. Esto significa entender, aunque sea de forma básica, cómo los sistemas automatizados deciden qué información mostrar, qué priorizar y qué dejar fuera. Los algoritmos no son neutrales. Responden a reglas, intereses y diseños específicos. Comprender esto ayuda a no asumir que todo lo que aparece en pantalla es lo más importante, lo más verdadero o lo más completo.

La alfabetización digital no debería ser sólo una habilidad técnica. Debería formar parte de una ciudadanía crítica capaz de cuestionar lo que ve, lee y consume en entornos digitales. Por lo tanto, en lugar de preguntar nada más “¿cómo uso ChatGPT?”, la pregunta clave debería ser: ¿cómo pienso mejor con esta herramienta sin dejar de pensar por mí mismo?

Volviendo a la escena inicial, estudiantes que entregan trabajos correctos pero no comprenden lo que presentan, queda claro que el reto no es aprender a usar inteligencia artificial; el reto es aprender a usarla sin renunciar al pensamiento crítico.

Debemos estar conscientes de que el conocimiento se automatiza cada vez más, por lo tanto, la alfabetización digital, como parte de la democratización de la tecnología en México, debe centrarse en formar personas capaces de cuestionar, comprender y decidir. Sin eso, la tecnología deja de ser una aliada y se convierte en un atajo que debilita el aprendizaje.

Dang Anh-Hoang, V. T., & Nguyen, L.-M. (2025). Survey and analysis of hallucinations in large language models: Attribution to prompting strategies or model behavior. Frontiers in Artificial Intelligence, 8. https://doi.org/10.3389/frai.2025.1622292

Chen, Z., Yi, W., & Chen, J. (2025). Accuracy paradox in large language models: Regulating hallucination risks in generative AI. arXiv. https://arxiv.org/abs/2509.13345

Islam Tonmoy, S. M. T., Zaman, S. M. M., Jain, V., Rani, A., Rawte, V., Chadha, A., & Das, A. (2024). A comprehensive survey of hallucination mitigation techniques in large language models. arXiv. https://arxiv.org/abs/2401.01313

Alansari, A., & Luqman, H. (2025). A comprehensive survey of hallucination in large language models: Causes, detection, and mitigation. arXiv. https://arxiv.org/abs/2510.06265

Gangadharan, S., & Allison, A. (2024). Towards trustworthy LLMs: A review on debiasing and dehallucinating in large language models. Artificial Intelligence Review, 57, 243. https://doi.org/10.1007/s10462-024-10896-y

Álvarez Pacheco, A. C. (2025). Ahora más que nunca: la alfabetización digital. Observatorio / Instituto para el Futuro de la Educación. https://observatorio.tec.mx/alfabetizacion-digital/

Alfabetización digital. (s. f.). Glosario de términos educativos. Instituto Nacional para la Evaluación de la Educación (INEE). https://inee.org/es/glosario-EeE/alfabetizacion-digital

Ridley, M., & Pawlick-Potts, D. (2022). Algorithmic literacy and the role for libraries. Information Technology and Libraries, 40. https://doi.org/10.6017/ital.v40i2.12963

Swart, J. (2020). Tactics of algorithmic literacy: How young people understand and negotiate algorithmic news selection. AoIR Selected Papers of Internet Research. https://doi.org/10.5210/spir.v2020i0.11342

UNESCO. (2016). Alfabetización digital y seguridad digital: La importancia de mantenerse seguro e informado. Organización de las Naciones Unidas para la Educación, la Ciencia y la Cultura. https://es.unesco.org/themes/alfabetizacion

Martín Yeshuá Barragán Cruz

Redactor en EXPOST

Todos los derechos reservados IEXE 2022 Aviso de Privacidad Contacto